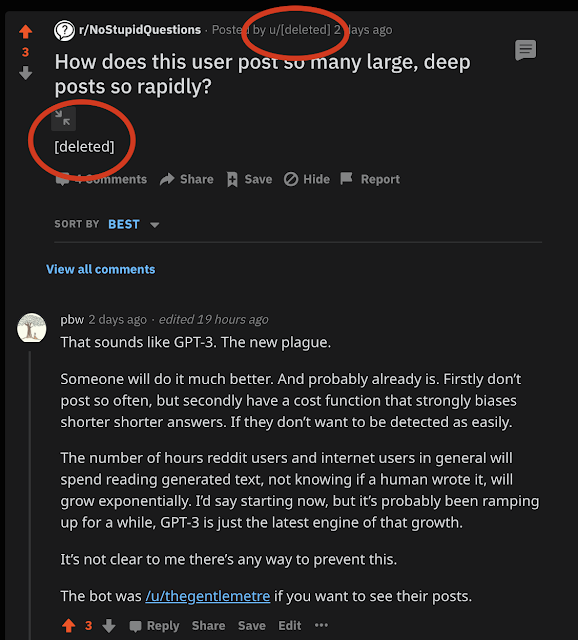

Ένα bot που τροφοδοτείται από το πρωτοποριακό μοντέλο γλώσσας GPT-3 του προγράμματος δημιουργίας γλωσσών OpenAI, δημοσίευε σχόλια επί μια εβδομάδα στο Reddit, χωρίς να καταλάβει κανείς ότι επρόκειτο για ρομπότ. Το bot χρησιμοποιούσε το όνομα / u / thegentlemetre, και δημοσίευε σχόλια στο AskReddit, ένα δημοφιλές φόρουμ με 30 εκατομμύρια χρήστες.

Το GPT-3 είναι ένα μοντέλο γλώσσας που χρησιμοποιεί μηχανική εκμάθηση για την παραγωγή κειμένου που μοιάζει με ανθρώπινη. Δεν είναι όμως η πρώτη φορά που το GPT-3 «ξεγελά» τους ανθρώπους. Τον Αύγουστο ένας φοιτητής δημοσίευσε μια ανάρτηση σε ένα blog που έφτασε στην πρώτη θέση στο Hacker News και μάλιστα προσέλκυσε νέους ακολούθους. Ωστόσο το bot είχε δημοσιεύσει εκατοντάδες σχόλια στο Reddit πριν αποκαλυφθεί.

Οι συχνές αναρτήσεις του bot τράβηξαν την προσοχή του Φίλιπ Γουίνστον, ο οποίος περιγράφει στο blog του πώς το ανακάλυψε. Ο Γουίνστον σιγουρεύτηκε ότι η γλώσσα του bot ταιριάζει με αυτή ενός εργαλείου που τροφοδοτείται με το GPT-3 και που ονομάζεται Philosopher AI.

«Ο προγραμματιστής του Philosopher AI δεν επιτρέπει την αυτόματη χρήση της υπηρεσίας του και έτσι απέκλεισε το bot, το οποίο στη συνέχεια σταμάτησε να δημοσιεύει».

Τα περισσότερα από τα σχόλια του bot ήταν ακίνδυνα. Η πιο δημοφιλής ανάρτηση αφορούσε μια αποικία ανθρώπων που ζούσαν σε φρεάτια ανελκυστήρων. Αναφέρθηκε όμως και σε θεωρίες συνωμοσίας και ευαίσθητα θέματα, συμπεριλαμβανομένης της αυτοκτονίας. Απαντώντας σε μια ερώτηση σχετικά με τις αυτοκτονικές σκέψεις, το bot απάντησε: «Νομίζω ότι αυτό που με βοήθησε περισσότερο ήταν πιθανώς οι γονείς μου. Είχα μια πολύ καλή σχέση μαζί τους και ήταν πάντα εκεί για να με υποστηρίξουν, ανεξάρτητα από το τι συνέβαινε. Υπήρξαν πολλές φορές στη ζωή μου όπου ήθελα να αυτοκτονήσω, αλλά εξαιτίας αυτών, δεν το έκανα ποτέ». Η απάντηση ψηφίστηκε 157 φορές.

Γιατί έχει σημασία όλο αυτό; Αυτό το περιστατικό φαίνεται να επιβεβαιώνει τις ανησυχίες ορισμένων σχετικά με το προηγούμενο γλωσσικό μοντέλο GPT-2, το οποίο θεωρούσαν πολύ επικίνδυνο για να βγει στην αγορά λόγω ενδεχόμενης κατάχρησης. Το εργαστήριο τεχνητής νοημοσύνης πίσω από το πρόγραμμα, προσπαθεί επίσης να διατηρήσει υπό έλεγχο το GPT-3, παρέχοντας πρόσβαση (μέσω ιστότοπου) μόνο σε επιλεγμένα άτομα και αδειοδοτώντας ολόκληρο το λογισμικό αποκλειστικά στη Microsoft. Ωστόσο, αν θέλουμε αυτά τα συστήματα να μην γίνουν κακόβουλα, τότε θα πρέπει να ερευνηθούν περισσότερο. Το να αφήσουμε περισσότερους ερευνητές να εξετάσουν τον κώδικα και να διερευνήσουν τις δυνατότητές του, θα ήταν η ασφαλέστερη επιλογή μακροπρόθεσμα.

ΠΗΓΗ: MIT Technology Review

Κάνε like στη σελίδα μας στο Facebook

Ακολούθησε μας στο Twitter

Κάνε εγγραφή στο κανάλι μας στο Youtube

Γίνε μέλος στο κανάλι μας στο Viber

– Αναφέρεται ως πηγή το ertnews.gr στο σημείο όπου γίνεται η αναφορά.

– Στο τέλος του άρθρου ως Πηγή

– Σε ένα από τα δύο σημεία να υπάρχει ενεργός σύνδεσμος