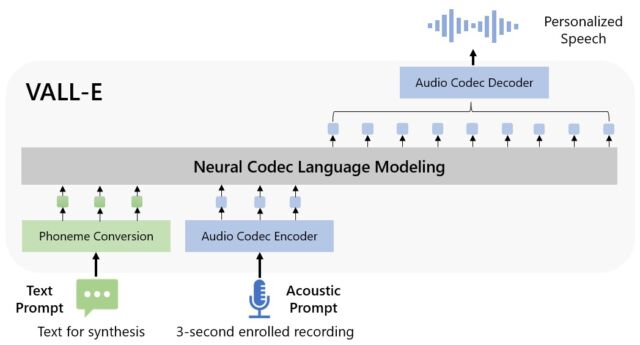

Η Microsoft παρουσίασε τo VALL-E, ένα πρωτοποριακό μοντέλο μετατροπής κειμένου σε ομιλία (text-to-speech, TTS), το οποίο μπορεί να μιμηθεί τη φωνή κάποιου μελετώντας ένα δείγμα ήχου διάρκειας 3 δευτερολέπτων. Το VALL-E μπορεί επίσης να αναπαράγει τη χροιά και τον συναισθηματικό τόνο του ομιλητή, αλλά και την ακουστική του δωματίου στο οποίο ηχογραφήθηκε το ηχητικό δείγμα.

Οι ερευνητές εκπαίδευσαν το VALL-E με το Libri-Light – ένα σύνολο δεδομένων ανοιχτού κώδικα της Meta- το οποίο περιλαμβάνει 60.000 ώρες αγγλικής ομιλίας με περισσότερους από 7.000 μοναδικούς ομιλητές.

Το «γλωσσικό μοντέλο νευρωνικού κωδικοποιητή» όπως αποκαλεί το VALL-E η Microsoft, βασίζεται σε μια τεχνολογία που ονομάζεται EnCodec, την οποία παρουσίασε η Meta τον Οκτώβριο του 2022. Σε αντίθεση με άλλα συστήματα που βασίζονται στον χειρισμό κυματομορφών για τη σύνθεση ομιλίας, το VALL-E μπορεί να δημιουργήσει ήχο από την εισαγωγή κειμένου και μικρά δείγματα ήχου του ομιλητή.

Η ταχεία βελτίωση της τεχνολογίας αυτής εγείρει διάφορα ηθικά και νομικά ζητήματα. Η φωνή ενός ατόμου θα μπορούσε να καταγραφεί και να αναπαραχθεί για ευρεία χρήση – σε διαφημίσεις, ανεπιθύμητες κλήσεις, chatbot και deepfake.

Ο Πάτρικ Χαρ, Διευθύνων Σύμβουλος της εταιρείας SlashNext κατά του phishing, δήλωσε στον ιστότοπο The Register, ότι θα μπορούσε να γίνει ένα ακόμη εργαλείο για τους εγκληματίες του κυβερνοχώρου.

«Αυτή η τεχνολογία θα μπορούσε να είναι εξαιρετικά επικίνδυνη σε λάθος χέρια», είπε ο Χαρ.

Οι ερευνητές της Microsoft είπαν ότι υπάρχει η πιθανότητα να αναπτύξουν ένα μοντέλο ανίχνευσης που θα μπορεί να εντοπίζει εάν ένα ηχητικό κλιπ είναι πραγματικό ή έχει δημιουργηθεί με το VALL-E.

«Δεδομένου ότι το VALL-E θα μπορούσε να συνθέσει ομιλία που διατηρεί την ταυτότητα του ομιλητή, μπορεί να ενέχει πιθανούς κινδύνους κατάχρησης του μοντέλου, όπως η παραποίηση της φωνητικής αναγνώρισης ή η πλαστοπροσωπία ενός συγκεκριμένου ομιλητή. Θα εφαρμόσουμε επίσης τις αρχές της Microsoft AI κατά την περαιτέρω ανάπτυξη των μοντέλων», έγραψαν οι επιστήμονες.

ΠΗΓΗ: Interesting Engineering, Ars Technica

Κάνε like στη σελίδα μας στο Facebook

Ακολούθησε μας στο Twitter

Κάνε εγγραφή στο κανάλι μας στο Youtube

Γίνε μέλος στο κανάλι μας στο Viber

– Αναφέρεται ως πηγή το ertnews.gr στο σημείο όπου γίνεται η αναφορά.

– Στο τέλος του άρθρου ως Πηγή

– Σε ένα από τα δύο σημεία να υπάρχει ενεργός σύνδεσμος